引言

在当今数字化浪潮中,人工智能技术的发展速度令人瞠目结舌。阿里云近日宣布开源一款名为Qwen2.5-Omni-7B的全模态大模型,这不仅是通义系列模型中的首个端到端全模态大模型,更是智能语音领域的一大突破。这一消息迅速引起了业界的广泛关注和热议。本文将深入探讨这款7B小模型的特点、应用领域以及其对人工智能技术发展的意义。

模型特点

全模态感知能力

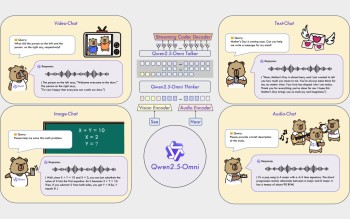

Qwen2.5-Omni-7B模型的一个显著特点是其全模态感知能力。所谓全模态,是指模型能够处理多种类型的输入数据,包括文本、图像、音频和视频等。这种多模态能力使得模型在处理复杂任务时更加灵活和高效。例如,在智能语音助手中,用户可以通过语音输入进行查询,模型不仅能理解语音内容,还能结合图像和视频信息进行更准确的响应。

端到端设计

这款7B小模型采用端到端的设计理念,从数据输入到输出的整个过程都由一个统一的模型完成。这种设计使得模型在处理复杂任务时更加高效,减少了中间环节的数据转换和处理,提升了整体的智能化水平。端到端设计还使得模型的训练和优化更加简便,能够更快地适应不同的应用场景。

预训练数据的优势

Qwen2.5-Omni-7B模型在大量预训练数据上进行了训练,这使得它在预测和推理能力上表现出色。预训练数据的丰富性和多样性是模型成功的关键。通过学习大量的自然语言、图像和音频数据,模型能够更好地理解和生成人类语言,提供更加准确和自然的响应。

应用领域

AI视频通话

在AI视频通话领域,Qwen2.5-Omni-7B模型的全模态感知能力可以极大地提升用户体验。例如,在视频通话中,模型可以同时处理语音、图像和视频信息,提供更加智能的响应和互动。用户可以通过语音指令控制视频通话的各种功能,如调整画面、切换背景等,极大地提升了通话的便捷性和智能化水平。

智能对话

智能对话是人工智能技术的重要应用领域之一。Qwen2.5-Omni-7B模型在智能对话中的表现同样出色。通过全模态感知能力,模型能够更好地理解用户的语音和文字输入,提供更加准确和自然的响应。例如,在客服对话中,模型可以根据用户的问题自动生成相应的回答,极大地提升了客服效率和用户满意度。

其他应用场景

除了AI视频通话和智能对话,Qwen2.5-Omni-7B模型还可以应用于其他多个领域。例如,在智能家居中,模型可以通过语音指令控制家电设备,如调节空调温度、开关灯光等;在医疗领域,模型可以通过图像和音频信息辅助医生进行诊断和治疗;在教育领域,模型可以通过多模态信息提供个性化的学习建议和辅导。

开源动向

促进技术创新

阿里云通过开源Qwen2.5-Omni-7B模型,不仅丰富了人工智能技术的选择,还推动了技术创新的发展。开源模型使得更多的开发者和研究人员可以基于此模型进行二次开发和研究,推动人工智能技术的进一步发展。开源还促进了技术的共享和协作,使得更多的优秀技术能够惠及广大用户。

提升用户体验

开源模型的推出,使得更多的企业和个人可以使用先进的AI技术,提升用户体验。例如,通过使用Qwen2.5-Omni-7B模型,企业可以开发出更加智能的产品和服务,如智能客服、智能家居等,极大地提升了用户的满意度和忠诚度。

结语

阿里云开源的Qwen2.5-Omni-7B模型,以其全模态感知能力和端到端设计,为智能语音领域带来了新的突破。其在AI视频通话、智能对话等多个领域的应用,极大地提升了用户体验和智能化水平。开源模型的推出,不仅促进了技术创新和共享,还为广大用户带来了更加便捷和高效的智能化服务。相信随着人工智能技术的不断进步,我们将看到更多智能化产品和服务的涌现,为人们的生活带来更多便利和惊喜。