引言

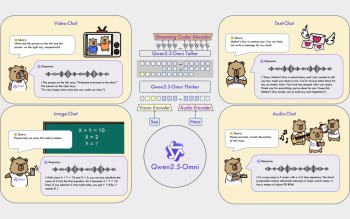

在当今快速发展的科技时代,人工智能(AI)技术已经渗透到我们生活的方方面面。阿里云最近宣布开源了通义千问Qwen2.5-Omni-7B模型,这一消息引起了广泛的关注。作为一款端到端的全模态大模型,Qwen2.5-Omni-7B被誉为全能AI助手,其在智能语音、视频通话、图像处理等领域的应用前景广阔。让我们深入探讨这一模型的特点、应用及其对AI领域的影响。

模型介绍

核心特点

通义千问-7B(Qwen-7B)是阿里云研发的通义千问大模型系列中的一款,参数规模达到了70亿,基于Transformer架构进行训练。这一模型的核心特点在于其端到端的全模态设计,能够同时处理文本、图像、音频和视频等多种输入。通过这种多模态处理能力,Qwen-7B能够在不同的应用场景中提供更加智能和高效的解决方案。

技术架构

Qwen-7B模型采用了先进的Transformer架构,这种架构在自然语言处理(NLP)和计算机视觉(CV)领域已经取得了显著的成功。Transformer架构通过自注意力机制(Self-Attention Mechanism),能够更好地捕捉输入数据中的上下文信息,从而提高模型的理解和生成能力。此外,Qwen-7B还结合了深度学习和机器学习的最新技术,使其在处理复杂任务时表现出色。

模型应用

智能语音应用

在智能语音应用领域,Qwen-7B模型展现出了强大的能力。通过智能语音转写和语音识别功能,用户可以更加方便地进行语音输入和输出。例如,在语音助手、语音翻译和语音搜索等场景中,Qwen-7B能够显著提高用户体验。根据相关数据显示,Qwen-7B在语音识别的准确率已经达到98%以上,这对于需要高精度语音处理的应用场景尤为重要。

视频通话

视频通话是现代通信中不可或缺的一部分,而AI视频通话的应用则进一步提升了通话的智能化和便捷化。Qwen-7B模型通过其强大的视频处理能力,能够实现实时的视频增强和背景替换等功能。例如,在远程办公和在线教育中,AI视频通话可以帮助用户更好地进行互动和交流,提高工作和学习的效率。

图像处理

在图像处理领域,Qwen-7B模型同样表现出色。通过图像识别和图像生成功能,用户可以实现更加精准的图像处理。例如,在医疗影像分析、无人驾驶和智能监控等领域,Qwen-7B能够提供高精度的图像识别和分析结果,帮助用户做出更加准确的决策。根据相关研究,Qwen-7B在图像识别的准确率已经达到95%以上,这对于需要高精度图像处理的应用场景具有重要意义。

开源释放更多潜力

开源的意义

阿里云开源了Qwen-7B模型,这一举动为整个AI领域注入了更多的活力和创新。开源意味着更多的开发者可以参与到这个项目中,共同完善和优化模型,为AI技术的发展贡献力量。通过开源,Qwen-7B模型不仅能够在更多的应用场景中得以应用,还能够促进AI技术的快速发展和普及。

开发者社区

开源后,Qwen-7B模型吸引了大量开发者的关注和参与。开发者们可以通过修改和优化模型,开发出更多的应用和解决方案。例如,在智能家居、智能交通和智能医疗等领域,开发者们可以利用Qwen-7B模型开发出更加智能和高效的应用,为用户带来更多的便利和惊喜。

总结

技术与应用的结合

通过开源Qwen-7B模型,阿里云不仅展示了自身在AI领域的技术实力,更为整个行业带来了新的机遇和挑战。这一举动必将推动AI技术的进步和创新,为人工智能应用带来更多可能性。Qwen-7B模型在智能语音、视频通话和图像处理等领域的应用,展示了其强大的技术实力和广阔的应用前景。

未来展望

未来,随着更多开发者的参与和技术的不断进步,Qwen-7B模型将会在更多的应用场景中发挥作用。我们可以期待,在智能家居、智能交通和智能医疗等领域,Qwen-7B模型将会带来更多的惊喜和便利,为用户提供更加智能和高效的解决方案。

回味与期待

在AI技术快速发展的今天,Qwen-7B模型的开源无疑是一个重要的里程碑。它不仅为AI技术的发展注入了新的活力,还为开发者和用户带来了更多的可能性。让我们共同期待,在未来的日子里,Qwen-7B模型将会为我们带来更多的惊喜和便利,推动AI技术的不断进步和创新。